(图片来源:钛媒体App裁剪林志佳拍摄)

自2023年11月16日起,一款名为Kimi的 AI 应用家具在中国横空出世、已而爆红,在苹果App Store应用商店的下载名次中,一度出奇微信、抖音,冲到榜首。

被称为“中国版ChatGPT”的免费 AI 应用Kimi,能一语气径直进行200万字长文本处理,文笔比百度“文小言”(文心一言)愈加流通当然,激发酬酢平台筹办。

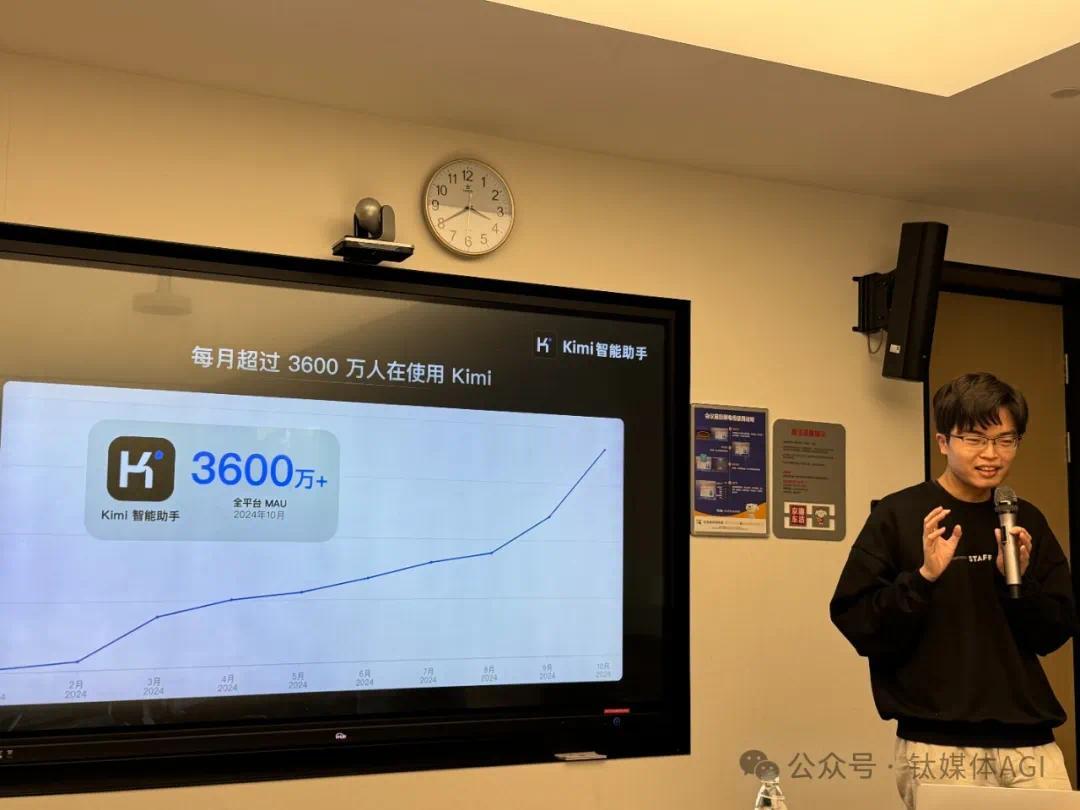

死心本年10月,每月有跳跃3600万东说念主在使用Kimi智能助手。

Kimi智能助手背后的“缔造者”,来自一家创立约579天的AI公司“月之暗面”(Moonshot AI),公司首创东说念主、CEO是一位31岁的连气儿创业者杨植麟。

杨植麟于清华大学筹备机系毕业、好意思国卡内基好意思隆大学筹备机博士,曾在Meta AI和Google AI研发团队做事过,同期他亦然Transformer-XL与XLNet两篇遑急论文的第一作家,两者均波及大谈话模子边界的中枢手艺,况且是中国35岁以下NLP(当然谈话处理)边界援用量最高的推断者。归国后,他曾教导团队参与盘古大模子的中枢手艺研发,还教导其长入创立的NLP公司轮回智能的家具研发。

跟着Kimi智能助手爆火,往日1年多,不管是月之暗面,如故杨植麟本东说念主,都濒临着巨大的争议与热度。

最先,融资层面,月之暗面优异的 AI 手艺、家具、应用和阛阓销售才气,让阿里巴巴、腾讯、红杉中国、好意思团、小红书、招商局中国基金等机构一窝风抢投,数月前满周岁时融资总数就已达数十亿元东说念主民币,公司估值已跳跃200亿元。

其次,AI大模子阛阓抓续“狂飙”,从“百模大战”到“价钱战”、落地应用竞争、“百变 AI 应用”等,大模子边界竞争加重,MoE(夹杂人人)、AI视频、及时语音对话、多模态、开源闭源、端侧模子等新手艺新时势约束清楚,而在此之前,Kimi在部分家具功能层面是有所缺失的,而且在Kimi免费下,月之暗面每月大都投流和研发进入,导致阛阓运转怀疑其买卖盈利才气和历久行业竞争力。

临了,杨植麟近期“被仲裁风云”激发存眷,金沙江创投等5家前投资东说念主向媒体骄气仲裁音讯,让更多东说念主担忧接下来公司的发展情况。

围绕“昨天、今天和翌日”这些话题,11月16日下昼,北京海淀京东科技大厦,闭关手艺研发数月的杨植麟,在Kimi Chat全面盛开一周年日,不仅发布了对标o1的全新kimi数学模子——k0-math(将来一两周内上线kimi探索版),而且还与钛媒体App等对诸多话题进行通常与陈述。

不管大众是否透彻舒畅,但咱们信赖,杨植麟仍是在尽最大起劲“陈述一切”。

谈投放和资本:Kimi留存率很遑急,这与AGI有正关系作用

当问及最近出现 AI 创业公司被收购、东说念主才回流的答应,kimi何如看待现时 AI 发展近况?

对此,杨植麟暗示,“咱们莫得遭受。我以为也很广博,行业发展进入新的阶段,之前有好多公司在作念(大模子),当今有一些小公司在作念,行业发展规则。”

他谈到,本年2、3月份运转,月之暗面运转聚焦和缩减(出海业务)。

“我认为应该作念减法,不是猖獗的作念加法,愈加应该聚焦业务。”杨植麟强调,提高留存率是很遑急的,留存率和AGI是正关系历程,当今与AGI还有一定的距离,今天作念的交互才气还很有限。

随后,杨植麟补充称,“这亦然咱们往日一年相比大的 lesson(阅历),咱们一运转尝试过几个家具一块作念,这在一定时间内成效,但自后发现,这么就活生生把我方形成大厂了,莫得任何上风。”

“砍业务骨子上亦然在按捺东说念主数。这几个大模子创业公司里,咱们恒久保抓东说念主数最少,恒久保抓(算力)卡和东说念主的比例最高,咱们主动遴选作念了业务的减法,应该聚焦把一个业务家具作念好。咱们不但愿团队扩那么大,(扩大)对转换有致命性伤害。另外,咱们也会字据好意思国阛阓的情况,判断哪个业务作念大的概率更高。你看,ChatGPT有5亿东说念主次月活,仍是是超等应用,虽然也有其他应用很难‘破圈’,咱们看到了好意思国阛阓的情况,遴选聚焦,聚焦在咱们认为上限最高的事情上,而且这跟咱们的 AGI misson(责任)也最关系。”杨植麟称,kimi需要聚焦能产生用户价值的层面。

据悉,这次公布的全新一代数学推理模子 k0-math。基准测试骄气,Kimi k0-math 的数学才气可对标全球最初的 OpenAI o1 系列可公开使用的两个模子:o1-mini和o1-preview。在中考、高考、考研以及包含初学竞赛题的MATH等 4 个数学基准测试中,k0-math 初代模子收成跳跃o1-mini和o1-preview模子。在两个难度更大的竞赛级别的数学题库 OMNI-MATH 和 AIME 基准测试中,k0-math 初代模子的施展分裂达到了 o1-mini 最高收成的 90% 和 83%。

同期,Kimi 探索版也通逾期骗强化学习手艺转换了搜索体验,注意图增强、信源分析和链式念念考三大推理才气上终了打破。

杨植麟先容,k0-math 模子和更强盛的 Kimi 探索版,将来几周将会分批赓续上线 Kimi 网页版和Kimi智能助手APP,匡助大众处理更有挑战的数学和搜索调研类任务。

临了,被问及前段时分据估算Kimi本年投放的金额有4、5亿,大部分是竖屏视频告白,那么Kimi的投流战略是什么?

杨植麟陈述称,最先数据不准确,其次,“对咱们来讲,最中枢的如故把留存和增长作念好。妥当的投放是需要的,但需要均衡好这几个东西之间的关系。”

谈与豆包竞争:不应该存眷竞争自己

当被问及怎么看待kimi跟豆包的竞争,杨植麟对钛媒体App等暗示,不应该存眷竞争自己。

“咱们如故以为更但愿存眷在何如能给用户信得过价值上,我不但愿咱们过多的去存眷竞争自己,因为竞争自己并不产生价值,我以为咱们只消diliver更好的手艺和家具,给用户创造更大的价值,是以这是咱们当今最中枢的问题。咱们会更聚焦在你何如提高模子的念念考推理才气,通过这个东西给用户带来更大的价值,即是作念正确的事情,而不非常去作念不一样的事情。因为我以为只消能有东说念主终了AGI它都是相配好的结果。”杨植麟称。

在杨植麟看来,投流不是当下kimi探究的遑急问题,更遑急的是留存是否有增长。

那么对于ROI是否为正,杨植麟暗示,“对咱们来说当今最要津的如故留存,我以为这个如故需要看的再长期一些。看你何如量度(ROI)吧,笃信这个东西需要去算,咱们也会抓续的提高,咱们的刚正是跟手艺的进展是高度正关系的。”

对于资本,大时势推理资本问题也很遑急。因此,杨植麟骄气,Kimi将来会探究次数适度,但不管是探索如故数学模子版,本粗放率会让用户我方去遴选。

“历久来讲,资本亦然约束下落的历程。比如说本年你若是达到客岁GPT-4模子的水平,你可能只需要十几B(数百亿边界)的参数就能作念到,此前可能需要100B(1000亿)以上参数大模子。”在杨植麟看来,配资开户算力资本在约束下落,先把行业作念大更为中药。

谈多模态:咱们在内测中,交互才气是必要条款

钛媒体App问杨植麟,Sora行将发布,但Kimi很少看到多模态层面的家具更替,原因是什么?

对此,杨植麟暗示,“咱们也作念,咱们几个多模态的才气在内测。我是这么看的,多模态,我以为AI接下来最遑急的是念念考和交互这两个才气。念念考的遑急性广阔于交互,不是说交互不遑急,我以为念念考会决定上限,交互我以为是一个必要条款,比如说vision的才气,若是莫得vision(视觉)的才气没法作念交互。是以我以为它两个不太一样。”

杨植麟强调,多模态笃信是要作念的,“可是我以为是念念考决定它的上限。”

谈算力和Scaling Law瓶颈:素质来岁会到天花板,但Scaling还有更多空间

现时,Scaling Law被质疑存在瓶颈,OpenAI前首席科学家、SSI首创东说念主伊利亚(Ilya Sutskever)暗示,扩大预素质的结果仍是达到了平台期。所谓预素质,即使用大都未秀丽数据来素质东说念主工智能模子以齐集谈话时势和结构的阶段。

对于这个关系话题,杨植麟暗示,模子预素质仍是有一定的“天花板”,半代到一代的模子空间会在来岁开释出来,是以这种模子会作念到一个相比“极致的阶段”。但Scaling Law依然有好多空间,他对此依然很乐不雅。

”来岁我以为最初的模子会把预素质作念到一个相比极致的阶段,今天比如说,咱们去看最佳的模子,它粗放有医学空间不错去压榨。可是咱们判断,接下来最重心的东西会在强化学习上,即是‘范式’上会产生一些变化。可是它如故Scaling,并不是它毋庸Scale,仅仅说你和会过不同的形势去Scale,这是咱们的判断。”杨植麟称。

对于Scaling law天花板,杨植麟暗示乐不雅,他认为中枢原因在于用“静态数据集”,这其实是相比浅易粗暴的使用形势,当今用强化学习的形势,可能会产生更多的作用。“我当今以为相对来说,具体从作念法上来,我以为笃定性是相比高的,好多时候是信得过把它调出来的历程,是以我以为粗放率不错通过这种形势去作念出来,是以我以为它上限是很高的。”

谈数据泛滥和造作率优化:通盘这个词行业会变好

谈及数据造作和数据价值话题,杨植麟重心谈了一些,他认为素质更多数据,作念好奖励模子,减少尽可能造作数据等,这些都极为遑急。

“确乎,对于强化学习来讲是一个中枢的问题,比如说若是它是像以前作念Next—Token prediction(下一步Token预计)它是一个静态的数据的话,相对来讲手艺会更进修一些。可是对强化学习来讲,通盘的学习数据都可能是我方生成的,想了半天你也不知说念这个想法是对如故错,就会对你奖励模子的后果建议挑战。不光是奖励模子的后果,还包括你何如把奖励模子很有用的利用到学习的历程中,这么你就能够让它尽可能减少学习造作的东西。包括我刚刚讲的,可能有一些局限性在于,比如它猜出来了一个谜底,这种patten(图案)亦然素质历程中去阻止的,因此处理这个问题的中枢,是何如更好的素质奖励模子,成立奖励机制,有点像以前(GPT预素质pretraining)你还要作念好多的对都的做事,我以为其实对强化学习来说亦然一样的。”杨植麟认为,减少尽可能造作的东西,因此需要素质更多的数据,成立奖励机制,才可能处理数据泛滥等问题。

杨植麟强调,接下来,团队将运转探究改革奖励结构,“一定进度也会阻止这么的问题,这是咱们接下来想去处理的问题”。

对于数据、算力和算法均衡问题,杨植麟对钛媒体App暗示,需要作念更多的数据清洗,作念更好质地的数据,需要约束Scaling,这是通盘这个词行业的问题,他信赖“强化学习”会让这种均衡抓续变好。

“我以为AI的发展即是一个‘荡秋千’的历程。你会在两种状况之间走动切换,一种状况即是你算力不够,比如说你算法数据是相配ready,可是你的算力不够,是以你要再的事情即是作念更多的工程,把infra(基础才气)作念得更好。它就能够抓续的提高。我以为其实从Transformer降生到GPT4,其实更多的矛盾即是我何如能够Scale,可是你可能在算法和数据上可能莫得骨子的问题。

今天当你这个Scale差未几的时候,你会发现,我再加更多的算力,并不一定能径直处理这个问题,中枢是因为莫得高质地的数据,几十亿token是东说念主类互联网积蓄了20多年的上限。这个时候要作念的事情,即是我通过算法的改革,让这个东西不会成为瓶颈。当今不错齐集成,咱们遭受的问题或者通盘这个词行业遭受的问题,也许你径直加更多的卡,它不一定能看到径直的提高,是以你要通过这个形势的改革让它把这个东西开释出来。通盘的好算法,即是跟Scaling作念一又友,若是你的算法能够开释Scaling的后劲,它就会抓续变得更好。咱们从很早就运转作念强化学习关系的东西,我以为这个亦然接下来很遑急的一个趋势,通过这种形势去改革你的主张函数,改革你的学习的形势,让它能抓续的Scale。”杨植麟称。

中好意思大模子差距:我以为转换才气更遑急

其中谈到了中好意思大模子差距话题。

对此,杨植麟认为,这种(放缓)速率对于kimi是一件善事。中好意思莫得什么变化或者说差距,相对是一个常数,一段时天职算力不是瓶颈,转换才气愈加遑急。

“差距我一直以为相对是一个所长,对咱们来说它有可能是一个善事。假定你一直pre-train,你的预算本年1B、来岁10B或者100B,它不一定可抓续。虽然你执着也要Scaling,仅仅说你Scaling的开始很低。你可能Scale很长一段时分,在一段时天职你的算力就不会是瓶颈,这个时候你的转换才气是更遑急的,在这种情况下我以为对咱们反而是一个上风。”杨植麟暗示。

杨植麟强调,这次kimi发布的数学模子仍是解说,一是它不错在讲授等边界产生更大价值,也起到很遑急的作用,二则是Kimi在手艺上的约束迭代和考据。

“咱们不错把这个手艺去放在更多的场景里,比如探索版不错去作念好多的AI搜索,我以为它会有两层这么的含义。”杨植麟称。

(作家|林志佳,裁剪|胡润峰)